Tutto quel che c’è da sapere sul cloud computing: in questo articolo accanto alle spiegazioni relative cloud cos’è e cosa significa introdurlo in azienda, quanto è adottato in Italia e quali sono i settori aziendali più attivi nella “cloudification”, sono affiancate utili indicazioni alle imprese che hanno intrapreso il proprio percorso di adozione del cloud, tra gli argomenti affrontati quali scelte compiere in termini di competenze, storage, governance e sicurezza dei dati.

Ma partiamo dal principio.

Indice degli argomenti

Cos’è cloud computing? Differenza tra public, private e hybrid. Focus su IaaS, PaaS e SaaS

Il cloud computing è un modello che abilita l’erogazione di risorse informatiche (dalla capacità di calcolo, allo storage, sino alle applicazioni) rendendole disponibili on demand via Internet. Si tratta di un paradigma che risponde a quell’esigenza di flessibilità che caratterizza il sistema aziendale attuale offrendogli scalabilità dei sistemi, possibilità del pay per use, oltre a rapidità di erogazione dei servizi stessi e, d’altra parte, affidabilità e continuità di servizio.

Questa sintetica definizione fa più precisamente riferimento al public cloud computing, dove le risorse sono messe a disposizione da fornitori esterni che, nello specifico, possono dare tre categorie di servizi:

- IaaS (Infrastructure as a service, in pratica, la fornitura di veri e propri server e storage virtuali ma anche Api-Application program interfaces al fine di poter spostare workload in cloud),

- PaaS (Platform as a service, in questo caso viene virtualizzata una piattaforma e l’utente vi sviluppa le proprie applicazioni)

- SaaS (Software as a service, un modello di distribuzione che utilizza Internet come canale, le applicazioni in questione, si pensi per esempio ai gestionali, vengono infatti definite web services).

E ragionando in questo modo, si è arrivati a parlare di XaaS, ossia di Anything as a service…

Esistono però altri due modelli di riferimento ossia il private e l’hybrid cloud.

Un cloud privato è un sistema basato su un server/data center interno che crea un ambiente virtualizzato con la nuvola che “copre” esclusivamente l’ambiente aziendale più o meno esteso.

La soluzione intermedia tra le precedenti, ed è quella che sta avendo maggior successo, è rappresentata dal cloud ibrido che permette all’azienda, che dispone di un’infrastruttura consolidata di continuare a servirsene per esempio per applicazioni mission critical, ma allo stesso tempo, le consente di portare verso il cloud pubblico alcune attività, promuove migrazioni graduali eccetera.

In questo articolo ci si focalizzerà sui temi più caldi relativi a questo vasto mondo che prende il nome di cloud computing.

Il mercato del cloud computing in Italia

Si parla di cloud computing da diversi anni, ma solo da epoche più recenti i cloud system cominciano a generare fatturati, ossia iniziano davvero a essere adottati dalle aziende. Per poter affrontare il cambiamento di impostazione dei propri sistemi è dunque possibile, e molto utile, avere la possibilità di confrontare la propria situazione rispetto a quella di altri.

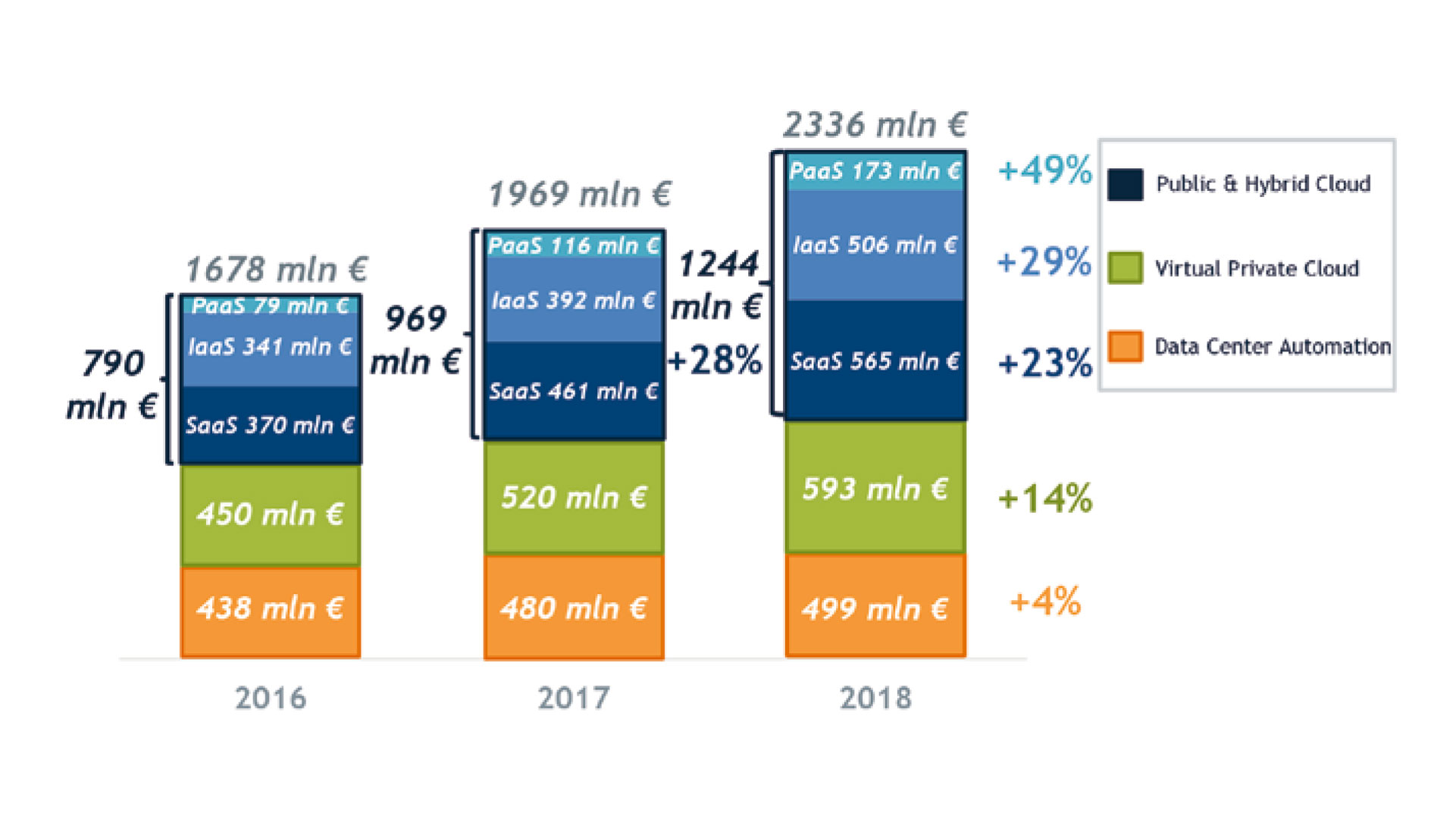

Secondo le più recenti stime dell’Osservatorio Cloud Transformation della School of Management del Politecnico di Milano nel 2018 il mercato cloud italiano vale 2,34 miliardi di euro, in crescita del 19% rispetto al valore di consuntivo del 2017, pari a 1,97 miliardi di euro.

La fotografia scattata dall’Osservatorio Cloud & Ict as a service School of management del Politecnico di Milano, l’anno scorso, aiuta a delineare il contesto di adozione del cloud in Italia. In tale immagine, risulta immediatamente evidente un gap significativo tra grandi imprese e Pmi (Figura 1). Poco più del 20% delle organizzazioni tra 10 e 49 addetti utilizza il cloud, la percentuale raggiunge invece quasi il 30% nelle organizzazioni tra 50 e 249 addetti.

Inoltre, la spesa in nuvola pubblica è effettuata per il 90% dalle large enterprise, che rispetto al 2015 hanno aumentato gli investimenti per una quota pari al 28%; il tasso di crescita relativo alle Smb si attesta invece di poco sotto al 20%.

Dal punto di vista geografico, le aziende del Nord Ovest dedicano maggiore budget al public cloud, mentre riguardo alla percentuale di crescita sul 2015, sempre la parte nordoccidentale della Penisola mostra maggiore dinamicità, mentre il Nord Est è la zona dove i servizi cloud hanno attualmente maggiore diffusione; seguono, con un certo distacco, il centro e sud e isole.

I settori più attivi nella cloudification (vedi Figura 2): il manifatturiero (con progetti per la gestione della supply chain) e, a seguire, le banche (con sperimentazioni in ambito ottimizzazione dei prezzi di strumenti finanziari, nei servizi di e-learning, big data eccetera). Sempre sul podio, telco e media che fruiscono dei vantaggi del cloud utilizzando i servizi di gestione dell’advertising e delle infrastrutture, per esempio, per lo streaming video per supportare picchi di attività.

Il comparto Servizi si concentra poi, sulla gestione delle flotte e dei ricavi; Gdo e Retail si indirizzano verso soluzioni di facility management degli store e di gestione dei dati multimediali.

Amministrazioni e sanità pubbliche prediligono il modello di Community Cloud, dove vengono sviluppati servizi verticali direttamente dagli Enti, mentre il ricorso a servizi Public cloud è concentrato su servizi più standard. Nelle Utility, storicamente, c’è stata una larga adozione di soluzioni Crm in cloud e più di recente di soluzioni orientate al risk management.

Le Assicurazioni paiono mostrare un approccio ancora standard alla nuvola, con sperimentazioni nell’ambito dei portali, dei sinistri e della relazione con la clientela.

Quali competenze e professioni sono richieste per realizzare un progetto di cloud computing

Un progetto cloud computing richiede un ripensamento organizzativo interno alla direzione Ict, il che comporta la necessità di selezionare, integrare, orchestrare e gestire infrastrutture, servizi così come le competenze professionali. A quest’ultimo proposito, secondo la fotografia di Assinform, ben il 53% delle aziende dichiara che proprio la mancanza di risorse e competenze rappresenta l’elemento che più rende complessa l’adozione di soluzioni public cloud.

Assinform suggerisce dunque di investire nelle seguenti aree:

- supply management, ossia di acquisire risorse umane in grado di gestire il processo di selezione del fornitore, tradurre le esigenze di business in requisiti, garantire il rispetto delle specifiche e, poi, verificare le prestazioni raggiunte dal fornitore;

- contract management, affinché vi siano persone che possano gestire le condizioni dei contratti di fornitura di servizi cloud computing;

- enterprise architecture, cioè in professionalità che sappiano sviluppare nel tempo un disegno architetturale che bilanci risorse interne ed esterne, integrandole seconde le specifiche esigenze;

- change management, per accompagnare le linee di business nel processo di adozione del cloud e

- performance management, in modo che possano essere ripensati gli indici di prestazione utili all’azienda per quantificare le performance e i livelli di servizio It erogati.

Questi ambiti professionali nuovi aprono, inevitabilmente, il dipartimento It al dialogo e all’interazione con altre aree aziendali. Si rende così sempre più necessario abbandonare le tradizionali divisioni interne e creare nuove unità orientate ai servizi. Il tutto all’insegna di maggiori integrazione e dinamismo. Al momento, secondo il 75% delle aziende interpellate da Assinform, la direzione Ict è la principale responsabile di tutte le fasi del processo di selezione e gestione di una soluzione public cloud, mentre solo nel 20% dei casi si è collaborato con le line of business. Vi è poi un 5% del totale dei piani considerati che è stato pensato esclusivamente dalle Lob …

Secondo gli ultimi dati comunicati in occasione della presentazione dell’Osservatorio Cloud Transformation 2018 della School of Management del Politecnico di Milano, il modello di riferimento per abilitare l’innovazione in azienda è però sempre più quello dell’hybrid cloud. Per adottarlo è necessario agire in determinati ambiti. Tra questi, pensando in modo particolare alla governance di tali ambienti, vi è sicuramente quello delle competenze. A causa dell’aumento di complessità dei Sistemi Informativi nelle direzioni IT servono nuove capacità sia tecniche sia in termini di soft skill nel relazionarsi con il resto dell’azienda.

“L’evoluzione delle competenze – ha sottolineato Mariano Corso, responsabile scientifico dell’Osservatorio Cloud transformation -richiede di pari passo nuove figure professionali specificatamente dedicate alla gestione del cloud nei suoi aspetti più operativi di sviluppo e gestione delle operations. Queste figure sono ancora poco presenti nelle aziende, ma sono di forte interesse per il futuro. Nelle organizzazioni più mature nell’adozione del cloud, l’introduzione di queste nuove figure professionali può perseguire una strategia di creazione di un centro di competenza dedicato alla gestione, tecnica e strategica, dei sistemi sulla nuvola. Ma oggi solo l’8% delle aziende risulta avere creato una struttura del genere. Il cloud rappresenta un acceleratore straordinario per la trasformazione digitale ma da solo non basta, il cambiamento riguarda soprattutto le persone e la cultura aziendale”.

Come scrivere un contratto di fornitura di servizi cloud

Analizzare e valutare dal punto di vista legale un modello di contratto avente come oggetto un servizio di cloud computing è un’operazione tutt’altro che semplice, sia perché richiede il possesso di specifiche competenze in ambito giuridico-informatico, sia perché la negoziazione di un servizio (e quindi la definizione di Sla – Service level agreement) di questo genere si differenzia radicalmente rispetto alle tradizionali modalità di contrattualizzazione e acquisizione di servizi informatici.

Le riflessioni che seguono certamente non vogliono, né possono, essere esaustive rispetto a una tematica che richiederebbe una trattazione molto più ampia, ma mirano a evidenziare alcuni degli elementi da considerare con attenzione nel momento in cui l’azienda inizi a valutare l’adozione di un servizio cloud.

In primo luogo, tra le più diffuse problematicità presenti nella maggior parte degli accordi di servizio proposti al mercato dai cloud provider assume particolare rilievo la marcata asimmetria che caratterizza i rapporti contrattuali tra il cloud provider e il cloud customer, il quale si trova per lo più a decidere se aderire o meno a condizioni di contratto che sono unilateralmente predisposte dal provider, a fronte delle quali il potere negoziale dell’utente del servizio è scarso o addirittura nullo.

In generale, è importante comprendere il reale contenuto dell’accordo oggetto di negoziazione sotto i molteplici profili in rilievo (tecnici, giuridici, di sicurezza, di compliance normativa, ecc.) e, infine, prevedere e ponderare le ricadute concrete delle previsioni contrattuali sui processi aziendali, anche sotto il profilo della valutazione dei rischi connessi ad indisponibilità, malfunzionamenti del servizio o violazioni accidentali o volontarie dei dati trattati.

Un ulteriore fattore di complicazione potrebbe inoltre esser dato dalla complessità della struttura contrattuale, spesso articolata in una molteplicità di documenti distinti, con la conseguente difficoltà a ricostruire e definire con precisione l’insieme delle obbligazioni che gravano su ciascuna delle parti.

In conclusione, il ricorso al cloud richiede un mutamento di prospettiva e di forma mentis rispetto alla contrattualizzazione tradizionale che, preso atto della diversità dei rapporti di forza che caratterizza l’offerta generalizzata di un servizio “preconfezionato”, si fondi un un’attenta analisi delle criticità, nella prospettiva di valutazione e mitigazione dei possibili rischi, piuttosto che sulla pretesa di riuscire a ottenere dal provider consistenti deroghe rispetto alla politica contrattuale e di servizio da questi diffusamente attuata sul mercato.

Valorizzare il PaaS per essere agili e veloci nel realizzare servizi e applicazioni

Nelle stime degli analisti, il segmento Paas ha fatto un balzo in avanti tra il 2015 ed il 2016, in particolar modo sul fronte dei servizi di Bpm – Business Process Management. Zion Market Research ha aggiornato i dati previsionali della crescita del mercato Paas in public cloud per il periodo 2015-2021, annunciando una crescita annua media superiore al 30%, con un volume di affari che dai 2,11 miliardi di dollari del 2015 arriverà a sfiorare i 10 miliardi entro la fine del 2021.

In questo momento il segmento con la crescita più elevata risulta essere il mercato specifico dei servizi di cloud application platform (aPaas, servizi di cloud pubblico che forniscono ambienti di sviluppo, test e rilascio di applicazioni) che pesa per il 34% del totale del mercato Paas.

Nei prossimi anni si assisterà a un boom di richieste di servizi iPaas – integration platform as a service (servizi che consentono di eseguire progetti di integrazione tra ambienti differenti, siano essi in cloud pubblico o on-premise come l’integrazione di fonti di dati, di servizi applicativi o di processi di business) che oggi pesano solo per poco più dell’11% sul mercato globale ma diverranno fondamentali nei progetti di hybrid It perché in grado di accelerare e migliorare la gestione, lo sviluppo e il monitoraggio dei flussi di integrazione tra data center aziendale e risorse It esterne.

Quanto è adottato il PaaS in Italia? Allo stato attuale si tratta di una scelta compiuta da un numero di realtà non particolarmente alto. Ma gli analisti, come evidenzia dall’Osservatorio Cloud & Ict as a service School of management del Politecnico di Milano, si aspettano la creazione di ecosistemi di partnership tra attori della filiera appartenenti a differenti categorie con l’obiettivo ultimo di semplificare la strada delle aziende nell’integrazione di servizi cloud, da un lato, e di questi ultimi con quelli on-premise, dall’altro.

Una visione che è supportata dal fatto che in questo momento si utilizzano questi sistemi a supporto dei dati (database e servizi di integrazione delle fonti di dati), così come sotto forma di framework applicativi ossia piattaforme per l’accelerazione dello sviluppo e del rilascio delle applicazioni e come strumento di integrazione applicativa. Tutti ambiti che dimostrano concretamente come si possa esprimere al meglio l’approccio bimodale: da un lato, si continua a lavorare sulla ‘macchina operativa interna’ (magari facendola evolvere anche mediante i servizi Iaas); dall’altro lato, si accelerano i percorsi di innovazione cercando nel Paas quell’elemento di agilità e velocità che permette alle aziende di arrivare sul mercato con nuovi servizi e applicazioni.

Lo storage in cloud, gli 8 passi per scegliere la soluzione più adatta alla propria azienda

Utilizzando il cloud computing i costi riconducibili allo storage indubbiamente diminuiscono, non essendoci hardware da acquistare, gestire e manutenere. Inoltre, il modello cloud, in generale, può assicurare un utilizzo dello storage al 100% eliminando le quote di risorse inutilizzate che in sistemi di enterprise data storage tradizionale sono necessarie per poter anticipare la crescita dei workload o fronteggiare, senza rischi di downtime, la gestione di picchi di richieste improvvisi da parte dei servizi It e delle applicazioni. Anche in questo caso è però importante definire quale modello adottare tra private, public e hybrid cloud. Come spesso capita, non esiste una regola generale, è, invece, utile prendere in considerazione alcuni dei ‘compromessi’ che potrebbero portare alla soluzione ottimale. Ed è partendo da tali ‘compromessi’ che Taneja Group, una società di analisi e consulenza specializzata in storage, server, networking e altre tecnologie infrastrutturali comprese quelle cloud e per i big data, ha redatto gli otto step da affrontare:

- stabilire qual è lo use case principale: a quale ambito fa riferimento il progetto (disaster recovery, backup, collaboration, storage primario, ecc.)? Questa è la primissima domanda che ci si deve fare dalla quale deriveranno una serie di informazioni strategiche per la scelta (probabilmente per il backup potrebbe risultare più conveniente scegliere un servizio di public cloud mentre per lo storage primario affidarsi ad infrastrutture e risorse interne);

- capire quali informazioni saranno archiviate e gestite dallo storage: si tratta di informazioni e dati in uso dagli utenti? Che tipo di applicazioni alimentano? Queste applicazioni funzionano anche in ambienti cloud? Capire queste ‘correlazioni’ è importante per non ritrovarsi a posteriori a dover spendere tempo e risorse per l’integrazione di sistemi con conseguenti rischi di falle nella sicurezza o addirittura di fallimento dei progetti;

- identificare la tipologia di storage: si è più orientati allo storage ad oggetti per cloud-architected application oppure verso block o file storage a supporto di applicazioni tradizionali? Se si deve supportare un progetto che prevede dati a disposizione di applicazioni cloud native, magari in continuo aggiornamento, probabilmente lo storage ad oggetti via public cloud sarà la soluzione più adatta;

- stabilire gli Sla per la disponibilità dei dati: per capire se una soluzione di public cloud è la risposta corretta a ciò che si cerca, bisogna prima capire quali sono i propri ‘requirement’ interni in modo da confrontare gli Sla interni con quelli forniti eventualmente da un service provider esterno;

- focalizzare l’attenzione su data security and privacy: esattamente come per gli Sla, per capire se e come un service provider sarà in grado di assicurare i livelli di sicurezza e privacy dei dati richiesti, è opportuno avere ben chiare le necessità interne stabilendo prima di tutto le proprie policy aziendali;

- fare attenzione alla compliance normativa: in questo caso è bene porsi tutte le domande di dettaglio specifiche per ciascuna normativa cui l’azienda deve essere compliant (avrò rispettato tutte le indicazioni della normativa ‘x’ usando un servizio di public cloud storage?)

- far combaciare i piani di recovery con i tempi forniti dal service provider: è importante che i tempi di recovery forniti dal cloud service provider siano in linea con gli obiettivi interni in termini di strategia e piano di disaster recovery;

- far dialogare storage interno con storage esterno: se lo storage primario è gestito da infrastrutture interne è bene capire come questo può interoperare con le altre risorse storage, specie se in public cloud (oppure il contrario, capire come lo storage esterno può fornire accessibilità locale in linea con lo storage primario in house senza creare quindi ripercussioni sui tempi di risposta e disponibilità del dato).

Cloud: come superare il problema della disponibilità di banda

Mentre una semplice connessione Internet può risultare sufficientemente efficace per l’accesso a servizi Saas e applicazioni mobile, molto del traffico di un data center che sfrutta connessioni 10 GbE, 40 GbE o 100 GbE [Gigabit Ethernet – tecnologie di computer networking per la connettività Ethernet a grandi velocità, 10, 40, 100 Gigabit al secondo – ndr] avrà problemi non banali una volta che lo stesso traffico verrà portato sulle reti Internet (vedi Figura 3).

Forrester ha ricordato tre trend che, secondo la società di analisi, dimostrano che Internet non è ritenuta sufficientemente performante per certi tipi di workload enterprise:

- è dal 2013 che i cloud provider stanno cercando soluzioni sempre più efficaci per offrire migliori metodi di connessione ai propri servizi;

- Amazon, Google e Facebook stanno estendendo le loro reti di connettività così come i siti di altri cloud provider;

- sta nascendo un nuovo consistente mercato di servizi di colocation, managed services e nuovi carrier di servizi Wan via cloud proprio in risposta a questa esigenza (connettività a supporto di determinati workload data center).

Quali saranno quindi i principali bisogni da soddisfare per supportare applicazioni e servizi digitali business critical che richiedono un effort maggiore rispetto alle connessioni Internet?

- Performance ‘consistenti’: alcuni tipi di traffico del data center necessitano di un certo ‘ammontare’ di banda di connettività, richiedono ‘diritti primari’ sulle code di traffico e le risorse di buffer (devono cioè essere processati con certe priorità e ‘privilegi’ nell’utilizzo delle risorse disponibili), ‘attraversare’ la rete nel minor tempo possibile ed inviare il playload in un determinato ordine (eseguire cioè i workload secondo specifiche regole e tempi). Per rispondere a simili complessità è necessario ‘costruire’ connessioni dedicate (ad hoc per certi workload e servizi mission/business critical) per le quali è fondamentale prevedere disponibilità di banda protetta e controllo delle performance incentrato sul ‘quality-of-service’;

- Soglie garantite: la maggior parte dei provider offre uptime con Sla di disponibilità del 99,9%, ciò significa garantire una connessione affidabile e robusta. Partendo dal monitoraggio delle applicazioni e dei servizi, per capire come lavorano e si comportano in base all’utilizzo degli utenti, i professionisti I&O potrebbero richiedere ai provider garanzie maggiori o minori, in base alle necessità del business (stabilendo delle soglie di disponibilità a seconda dei workload);

- Servizi complementari di protezione: l’esecuzione di tutte le applicazioni tramite una connessione Vpn – un singolo tunnel – potrebbe rappresentare una falla nella sicurezza. Questi tunnel singoli nascondono gli indicatori di performance e le regole necessarie all’ottimizzazione del traffico sulla rete. I professionisti I&O dovrebbero quindi ‘innervare’ il network con componenti di sicurezza in grado di abilitare politiche di protezione e controllo non solo del traffico ma anche dei dati e delle applicazioni (servono cioè ‘zero trust architecture’ a livello di rete ma costruite intorno a dati e applicazioni);

- Wan fabric: la rete diventerà un ‘large network fabric’; se le fabric connection potranno essere stabilite attraverso siti e location cross-connected, si eliminerà la complessità oggi evidente che molte aziende affrontano nel tentativo di collegare i servizi di carrier e service provider attraverso la rete Internet. È così possibile poter contare su maggiori performance e sicurezza e, inoltre, le spese di trasferimento dei dati attraverso network privati dedicati sono inferiori rispetto alle connessioni Internet pubbliche”.

Come si sta dunque muovendo il mercato dell’offerta per rispondere a queste esigenze? I telco e i service provider stanno lavorando per rendere le cose un po’ più semplici e agevolare le interconnessioni tra ambienti cloud sia attraverso Api open sia modellando sistemi di networking adatti a reggere i futuri scenari del multicloud (ossia ambienti ibridi e multi vendor interconnessi tra loro.

Molti cloud provider di rilievo hanno già lanciato sul mercato soluzioni specifiche proprio per abilitare questo tipo di connessioni, così come colossi quali Google o Facebook stanno estendendo le proprie reti di connettività per assicurare al mercato la qualità dei propri servizi erogati. All’interno di questa ‘categoria di soluzioni’ i meccanismi di delivery dei servizi si snodano lungo poche direttrici [la maggior parte dei provider offre connessioni private e dedicate che bypassano le connessioni pubbliche Internet – ndr]; di contro, sono invece numerose le opzioni che possono crearsi nei modelli tecnologici infrastrutturali sottostanti, quelli dedicati al ‘trasporto e routing’ dei servizi.

Figura 4: Opzioni che verranno a delinearsi attorno all’offerta di connessioni cloud private e dedicate

Fonte: Forrester

Ed è proprio su questi aspetti che Forrester focalizza l’attenzione sottolineando come siano le architetture sottostanti (quelle che consentono di trasportare il servizio da un ambiente ad un altro) a giocare un ruolo determinante dal punto di vista della gestione, della flessibilità e delle caratteristiche dei servizi stessi.

Ecco dunque le possibili opzioni che verranno a delinearsi attorno all’offerta di connessioni cloud private e dedicate (figura 4):

- One-to-one: si tratta di una tipica connessione basata su cavo Ethernet cross-connect [elemento dei sistemi di trasmissione dati la cui funzione è quella di smistare alte capacità di traffico tra le varie parti di una rete – ndr] oppure del noleggio di una linea privata che collega l’infrastruttura datacenter dell’azienda (in house o in co-location) direttamente all’edge del cloud provider. La flessibilità ed i tempi di distribuzione dei servizi dipenderanno dalle scelte del provider rispetto alla capacità ed alle risorse dedicate alla connessione. Il prezzo in genere viene stabilito sulla base di una tariffa mensile fissa se la connessione è cross e co-locata dal provider mentre sarà calcolata a costo per Mbps [Megabit per secondo, unità di misura che indica la capacità, quindi velocità, di trasmissione dei dati su una rete – ndr] per connessioni in fibra su lunghi percorsi e quindi a velocità variabile.

- One-to-many: in questo caso ci si riferisce ad un modello cosiddetto ‘cloud exchange’; similarmente a quanto avviene sulle reti IP, il cloud exchange funge da piattaforma per abilitare connessioni a più cloud. I clienti acquistano una ‘porta di connessione’ della piattaforma attraverso la quale avviene il provisioning dinamico delle risorse virtuali da parte di tutti i cloud provider connessi alla medesima piattaforma di scambio. In genere il prezzo viene calcolato con un fisso a singola porta cui si aggiungono costi mensili per ogni connessione virtuale.

- Any-to-any: in questo caso il modello è quello di una connessione IP VPN/MPLS cui si aggiunge un nodo cloud connesso alla Wan del cliente, fornendo così accesso al cloud da qualsiasi sede lavorativa o datacenter collegato alla Wan aziendale. Questo tipo di connessione può includere molteplici nodi cloud e può aiutare ad alleviare i colli di bottiglia che generalmente si creano quando si tenta di incanalare tutto il traffico cloud in un unico sito. Nel back end, queste connessioni possono essere indirizzate attraverso ‘peering point’ o ‘cloud exchange’. Si tratta generalmente di servizi offerti da carrier provider per cui soggetti a tariffe variabili in funzione di piani e ‘pacchetti’ tipici dei servizi Tlc.

Governance e sicurezza dei dati nel cloud

I servizi di cloud pubblico possono offrire un’interessante proposta per l’evoluzione e l’espansione dei data center aziendali ma, al tempo stesso, un’estensione frettolosa dell’infrastruttura It al public cloud, ovvero senza l’implementazione di un dominio di gestione dei dati completo, potrebbe esporre le organizzazioni It a un certo numero di rischi.

Prima di adottare i servizi di cloud pubblico i Cio dovrebbero pianificare e implementare in modo corretto il controllo sui dati nei loro ambienti It tradizionali e di cloud privato, prendendo in considerazione le esigenze di business, quelle dell’It e quelle provenienti dall’esterno dell’azienda, ivi compresi i requisiti normativi, di compliance e di governance.

Quanto agli aspetti tecnologici, gli analisti Idc suggeriscono di implementare una soluzione, una piattaforma universale, che abiliti un controllo ‘coerente’ e unificato sui dati lungo tutto lo stack It, indipendentemente da dove risiedano effettivamente le risorse infrastrutturali e applicative.

Vediamo allora cosa significa e quali dovrebbero essere le peculiarità di una simile piattaforma:

- multi-tenancy sicura: possibilità di ospitare diversi carichi di lavoro di numerose business unit senza alcun peggioramento dei servizi;

- risorse virtuali in pool: possibilità di astrarre le risorse hardware indipendentemente dal tipo e dall’ubicazione;

- portabilità dinamica dei dati: possibilità di spostare i dati in modo efficiente fra diversi ambienti cloud grazie a funzionalità di replica native e data protection;

- integrazione tra diversi ambienti e servizi: supporto di tutte le principali architetture per la gestione del cloud e la virtualizzazione, consentendo alle organizzazioni It di scegliere liberamente dove e come collocare le proprie risorse;

- possibilità di implementare una strategia multicloud: avere caratteristiche di scalabilità ed efficienza utili alle imprese per dimensionare al meglio la loro infrastruttura It, collocando dinamicamente applicazioni e set di dati associati nel ‘tier cloud’ più adatto, il tutto amministrato da un’unica console di gestione.

Per quanto riguarda invece gli ambienti ibridi, è necessario tenere presente che, per loro stessa natura, essi alterano le dinamiche per il controllo dell’infrastruttura, costringendo l’It a spostare l’attenzione sulla governance dei dati (indipendentemente dalla posizione delle risorse It e da dove vengano utilizzati i dati stessi).

Secondo gli analisti di Idc, le infrastrutture basate sul cloud ibrido possono dunque creare problemi proprio in termini di controllo sui dati. Vediamo quali:

- limitata possibilità di scelta in termini di service provider e/o percezione di lock-in: alcune imprese considerano i servizi di cloud pubblico come una forma di outsourcing, mentalità, secondo gli analisti, che aumenta la convinzione dell’inamovibilità dei dati spostati nel cloud. Non solo, il numero ancora limitato dei provider che offrono servizi completi di storage e gestione dei dati (che tengano quindi conto di tutte le funzionalità necessarie in termini di automazione e controllo) riduce le opzioni di servizi cloud a disposizione delle imprese.

- gestione di vari tipi di servizi storage: le organizzazioni It devono gestire tipi e classi di servizi storage che possono variare notevolmente da un provider all’altro e persino nelle infrastrutture storage on-premise;

- visibilità e mobilità dei dati: lo spostamento dei dati fra diversi tier di servizio on-premise o nel cloud può rivelarsi un’attività complessa; se l’automazione non viene accompagnata da efficaci meccanismi di monitoraggio dei dati, la visibilità dei dati potrebbe risultare compromessa;