L’intelligenza artificiale generativa ha compiuto passi da gigante negli ultimi anni, ma resta una sfida importante: come far dialogare in modo fluido i modelli AI con gli strumenti e i dati aziendali? È qui che entra in gioco il Model Context Protocol (MCP), uno standard open source che promette di rivoluzionare l’interoperabilità tra agenti AI e ambienti enterprise.

Indice degli argomenti

Cos’è il Model Context Protocol?

Il Model Context Protocol è un protocollo open source introdotto da Anthropic nel 2024, progettato per standardizzare la comunicazione tra modelli AI e strumenti esterni. MCP consente agli agenti AI di accedere a funzionalità aziendali – come database, API REST, ambienti di sviluppo, sistemi legacy – senza dover scrivere codice personalizzato per ogni integrazione.

La sua forza risiede nella modularità e nella riutilizzabilità: un server MCP può essere configurato una sola volta e poi utilizzato da diversi modelli e agenti AI, riducendo drasticamente i costi di sviluppo e manutenzione.

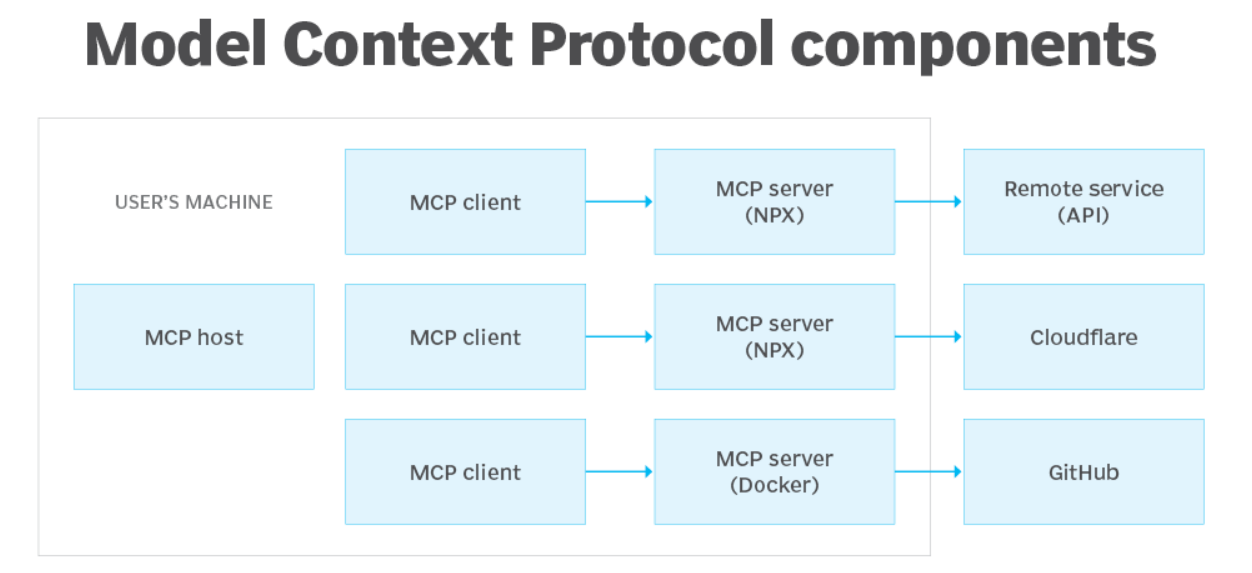

Architettura tecnica: host, client e server

Il protocollo si articola in tre componenti principali:

- MCP Host: è l’agente AI (come Claude, ChatGPT, o un modello custom) che riceve le richieste dell’utente e decide quali strumenti invocare.

- MCP Client: funge da ponte tra l’host e il server, gestendo il trasporto dei messaggi e la serializzazione.

- MCP Server: espone gli strumenti disponibili in formato JSON, descrivendone input, output, permessi e documentazione. Ogni tool è definito come una funzione invocabile, con metadati che ne facilitano l’uso da parte del modello.

La comunicazione avviene tramite JSON-RPC, un protocollo leggero e diffuso, con supporto per trasporti come stdio, HTTP, WebSocket e Server-Sent Events (SSE). Questo rende MCP compatibile con ambienti cloud, on-premise e ibridi.

Come MCP semplifica lo sviluppo AI

Tradizionalmente, integrare un modello AI con un sistema aziendale richiede la scrittura di wrapper, plugin o prompt specifici. MCP elimina questa complessità grazie a una interfaccia standardizzata che descrive ogni tool in modo machine-readable.

Per esempio, un tool che interroga un database può essere definito con:

{

"name": "query_database",

"description": "Esegue una query SQL sul database vendite",

"parameters": {

"query": "string"

},

"returns": {

"results": "array"

}

}

Il modello AI può leggere questa descrizione, capire come usare il tool e invocarlo autonomamente. Questo approccio è compatibile con framework agentici come LangChain, LlamaIndex, BeeAI, e ambienti come Cursor IDE e Claude Desktop, che già supportano MCP.

I benefici di MCP

L’adozione del Model Context Protocol offre una serie di benefici concreti per le organizzazioni che vogliono integrare l’intelligenza artificiale nei propri processi:

Standardizzazione e interoperabilità

MCP introduce un linguaggio comune tra modelli AI e strumenti aziendali. Questo consente di evitare soluzioni ad hoc, riducendo la frammentazione e facilitando l’integrazione tra sistemi eterogenei, siano essi legacy o moderni.

Scalabilità e riutilizzabilità

Un singolo MCP server può servire più agenti AI, anche di natura diversa. I tool definiti una volta possono essere riutilizzati in più contesti, riducendo i costi di sviluppo. Questo approccio favorisce la creazione di librerie di strumenti aziendali condivisi tra team.

Semplificazione dello sviluppo

Gli sviluppatori non devono più scrivere codice personalizzato per ogni modello o prompt. MCP consente di descrivere i tool in modo machine-readable, permettendo ai modelli di comprenderli e usarli autonomamente. Questo libera risorse e accelera il ciclo di sviluppo.

Governance e sicurezza

Grazie alla struttura modulare, MCP consente di implementare controlli granulari su ogni tool: chi può usarlo, con quali parametri, e in quali contesti. Questo facilita la compliance con policy aziendali e normative (es. GDPR, ISO 27001).

Flessibilità architetturale

MCP è agnostico rispetto al trasporto e al linguaggio di programmazione. Può essere implementato in ambienti cloud, on-premise o ibridi, usando Python, TypeScript o altri linguaggi. Questo lo rende adatto a infrastrutture IT complesse e distribuite.

Accelerazione dell’adozione AI agentica

Con MCP, le aziende possono passare da modelli AI passivi (che rispondono a domande) ad agenti attivi (che eseguono azioni). Questo apre la strada a use case avanzati come assistenti virtuali, orchestratori di workflow, e automazione intelligente.

Casi d’uso in ambito enterprise

Le applicazioni di MCP in contesto aziendale sono molteplici:

- Automazione di flussi di lavoro: un agente AI può orchestrare task tra Jira, GitHub, Slack e sistemi interni.

- Accesso a dati in tempo reale: senza retraining, il modello può interrogare database, API o file aziendali.

- Integrazione con strumenti legacy: MCP consente di esporre anche tool non moderni, purché siano accessibili via script o API.

Un esempio concreto: un agente AI per il supporto IT può accedere a un tool MCP che interroga lo stato dei server, apre ticket su ServiceNow e invia notifiche su Teams, tutto in modo autonomo e contestualizzato.

Sicurezza: rischi e mitigazioni

L’adozione di MCP introduce nuove superfici di attacco e rischi operativi:

- Tool non sicuri: se un tool esegue comandi shell o accede a dati sensibili, può essere sfruttato da un agente compromesso.

- Accessi non autorizzati: senza un sistema di permessi, un agente potrebbe invocare tool riservati.

- Audit trail assente: è difficile tracciare chi ha invocato cosa, quando e con quali parametri.

Per mitigare questi rischi, si raccomanda:

- Autenticazione e autorizzazione a livello di tool e utente.

- Sandboxing dei tool per limitare l’accesso al sistema.

- Logging dettagliato delle invocazioni.

- Rate limiting e validazione degli input.

IBM, ad esempio, ha integrato MCP nel suo ambiente watsonx.ai, con policy di sicurezza che isolano i tool e ne monitorano l’uso.

Come iniziare

Per i team IT interessati a sperimentare MCP, esistono SDK e server di riferimento in Python e TypeScript. Tra i progetti più attivi:

- fastMCP: server leggero e modulare per Python.

- wxflows: orchestratore MCP per ambienti enterprise.

- Claude Desktop: IDE che consente di testare tool MCP in locale.

La creazione di un MCP server richiede pochi passaggi:

- Definire i tool in formato JSON.

- Implementare le funzioni corrispondenti.

- Avviare il server MCP e collegarlo al client.

- Configurare l’agente AI per riconoscere e invocare i tool.

📘 Glossario Model Context Protocol

| Termine | Definizione |

|---|---|

| MCP (Model Context Protocol) | Protocollo open source che standardizza l’interazione tra modelli AI e strumenti esterni. |

| Agente AI | Modello AI capace di prendere decisioni autonome e interagire con strumenti e dati. |

| MCP Host | L’applicazione AI che riceve input dall’utente e decide quali tool invocare. |

| MCP Client | Componente che gestisce la comunicazione tra host e server MCP. |

| MCP Server | Server che espone strumenti (tool) in formato JSON, accessibili dai modelli AI. |

| Tool MCP | Funzione o servizio esposto dal server MCP, descritta con input/output e metadati. |

| JSON-RPC | Protocollo di comunicazione leggero basato su JSON, usato per invocare i tool MCP. |

| LangChain / LlamaIndex / BeeAI | Framework agentici compatibili con MCP, usati per orchestrare agenti AI. |

| Claude Desktop / Cursor IDE | Ambienti di sviluppo che integrano MCP per testare e usare tool AI. |

| Sandboxing | Tecnica di isolamento dei tool per evitare accessi non autorizzati o dannosi. |

| Audit Trail | Registro delle operazioni effettuate, utile per sicurezza e conformità. |

| RAG (Retrieval-Augmented Generation) | Tecnica AI che recupera informazioni da fonti esterne per migliorare le risposte. |

| SDK MCP | Kit di sviluppo per creare server MCP in Python o TypeScript. |