La crescente richiesta di elaborazione in tempo reale e di minore latenza sta spingendo l’adozione dell’edge computing. Secondo Gartner, entro il 2025 il 75% dei dati aziendali sarà generato ed elaborato al di fuori di un data center tradizionale.

La diffusione di sistemi IT distribuiti, del cloud computing e delle reti virtuali ha trasformato profondamente il ruolo dei data center tradizionali, che oggi alimentano anche tecnologie distribuite come IoT, 5G, robotica, machine learning e intelligenza artificiale andando oltre l’elaborazione e archiviazione dei dati.

L’edge computing consente che archiviazione, gestione e analisi avvengano vicino ai dispositivi remoti o agli utenti finali.

L’edge funziona di solito come parte di una strategia ibrida, connesso a un data center centrale. Tuttavia, un numero crescente di organizzazioni sceglie di sostituire i data center tradizionali con micro data center modulari.

Questa scelta è motivata anche dai limiti delle infrastrutture tradizionali: costi di manutenzione elevati, scarsa efficienza energetica, risorse sottoutilizzate, scalabilità limitata e maggiore impatto ambientale legato all’ingombro fisico.

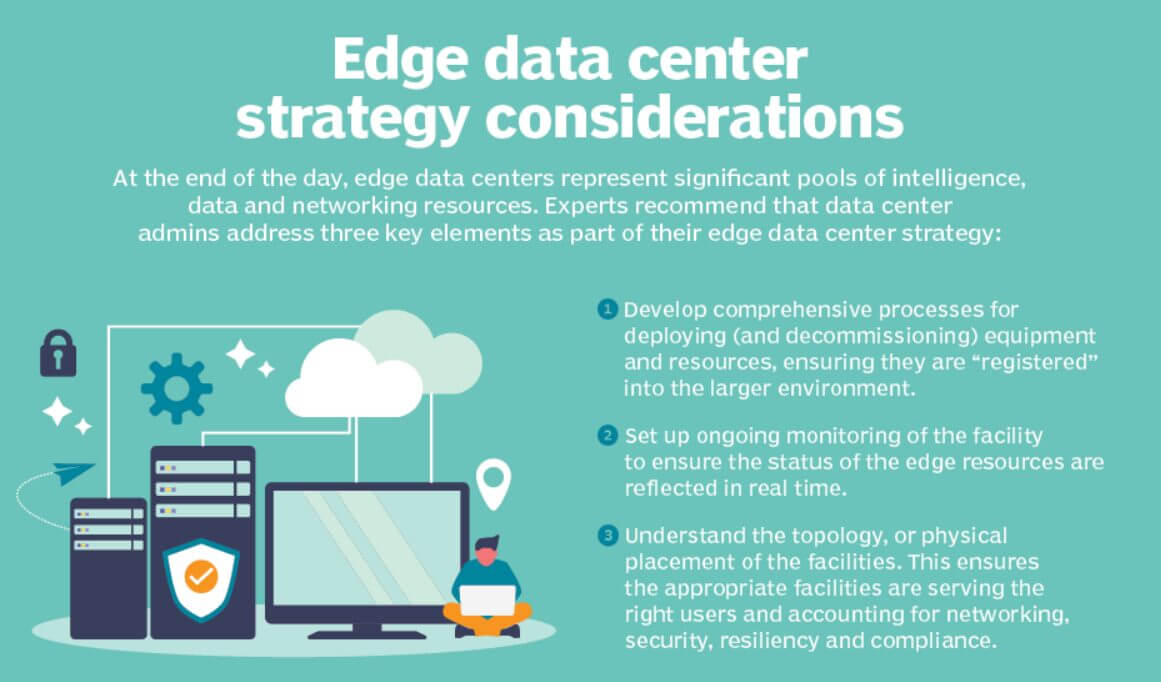

Per adottare con successo queste soluzioni, i CIO devono valutare con attenzione i requisiti di raccolta dati, la visibilità sui processi, i framework di sicurezza e il design fisico delle implementazioni edge.

Indice degli argomenti

Scalabilità e flessibilità grazie ai container

Dal punto di vista del design fisico, gli edge data center sono modulari e scalabili e comprendono diversi form factor. Compatti e autonomi, sono progettati per elaborare e archiviare dati localmente. Possono variare nelle dimensioni, da unità base di circa tre metri quadrati a sistemi più grandi assemblati con componenti prefabbricati completi di alimentazione e raffreddamento, per adattarsi alle esigenze specifiche dei carichi di lavoro.

Le organizzazioni possono combinare più unità in base alle necessità di elaborazione. Le unità modulari migliorano i tassi di trasferimento dei dati e consentono di ampliare le iniziative edge man mano che crescono le esigenze IT e il numero di dispositivi remoti e sensori IoT.

L’uso dei container consente inoltre di standardizzare il deployment di applicazioni e dispositivi, mantenendo coerenza ed efficienza. La containerizzazione integra applicazioni e dipendenze – librerie, binari e file di configurazione – in un sistema compatto che può funzionare su più ambienti, assicurando portabilità, elaborazione rapida e basso consumo di risorse, tutti elementi essenziali per l’edge computing.

Gestione dei dati, visibilità e sicurezza

L’elaborazione locale all’edge avviene quasi in tempo reale, a supporto di operazioni IT molto diverse: monitoraggio di asset e macchinari in settori industriali, rilevamento frodi in ambito finanziario, gestione della supply chain nel retail, veicoli autonomi. Grazie all’aggregazione e analisi dei dati in tempo reale, le aziende possono ridurre i costi e migliorare la reattività.

Gestione dei dati

Per gestire i dati generati all’edge, le aziende utilizzano sistemi di metadata management con tre obiettivi principali:

- instradare correttamente il traffico tra edge e core di rete,

- comprendere il contesto complessivo,

- prendere decisioni rapide di routing dei dati.

I possibili esempi d’uso? Le utility energetiche possono gestire meglio le smart grid, le aziende industriali monitorano più efficacemente asset e impianti, le strutture sanitarie elaborano metadati in tempo reale per migliorare l’assistenza ai pazienti.

Visibilità

La visibilità operativa resta un’esigenza fondamentale. Gli amministratori IT utilizzano tool di data center infrastructure management (DCIM) per monitorare in dettaglio le implementazioni: ottimizzazione dell’alimentazione, controllo delle condizioni ambientali, tracciamento di asset e inventario. Questi strumenti offrono anche visualization tools che forniscono metriche di stato, schemi e diagrammi generati automaticamente, accessibili da dashboard unificate.

Le aziende impiegano inoltre tool di AIOps per correlare eventi su sedi geograficamente distribuite, rilevare anomalie e risolvere problemi.

Sicurezza

La sicurezza informatica all’edge è fondamentale, poiché i dispositivi rappresentano un bersaglio privilegiato per gli attacchi. L’architettura zero trust, con l’approccio “never trust, always verify”, garantisce autenticazione e autorizzazione continue, verifica costante delle identità e rilevamento dei comportamenti anomali.

La cifratura è altrettanto importante: protocolli sicuri come TLS o HTTPS proteggono i dati in transito, mentre lo Advanced Encryption Standard (AES) protegge i dati memorizzati, garantendo conformità alle normative sulla privacy.

Le aziende devono inoltre adottare una data governance specifica per l’edge per garantire corrette pratiche di archiviazione, policy adeguate e rispetto delle leggi sulla sovranità dei dati nelle diverse giurisdizioni.

Prima di adottare l’edge computing

L’edge computing offre notevoli vantaggi in termini di efficienza operativa, ma richiede una progettazione accurata. Il primo passo consiste nell’identificare i dati da elaborare subito e quelli che possono essere trasferiti al cloud per analisi più approfondite.

Architetture più complesse richiedono strategie aggiuntive, come meccanismi di sincronizzazione dei dati, tecniche di edge caching e protocolli di replica per garantire coerenza e affidabilità su tutti i nodi distribuiti.